Das musst du wissen

- Auf vielen Online-Plattformen herrscht eine giftige Diskussionskultur.

- Google hat nun ein Programm entwickelt, mit dem man gehässige Kommentare einfach herausfiltern kann.

- Laut Experten beeinträchtigt das jedoch die Meinungsbildung. Besser sei es, sich Medienkompetenz anzueignen.

«Halts Maul!», «Dumme Kuh!», «Du hast den IQ von einem Weggli!»: Im Internet wimmelt es von gehässigen Kommentaren. Das kann dem geneigten Nutzer schnell mal den Tag vermiesen.

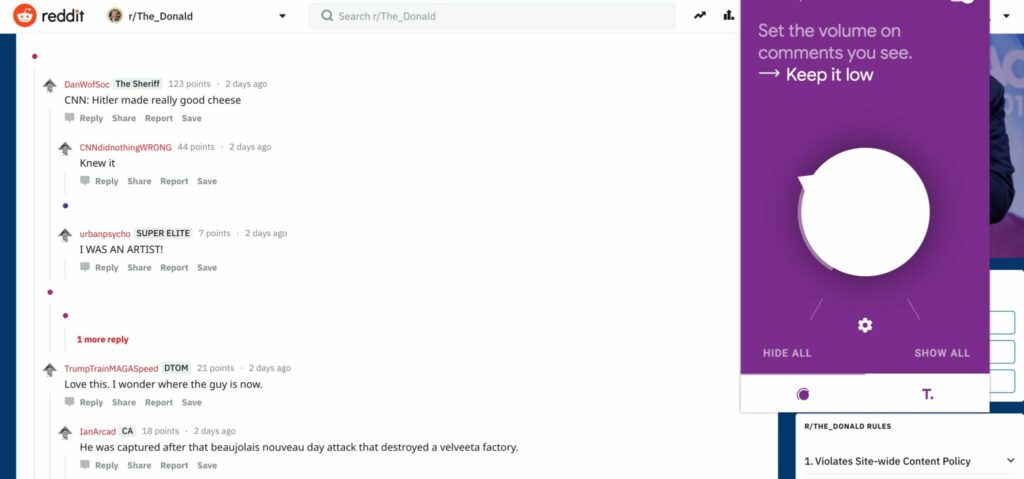

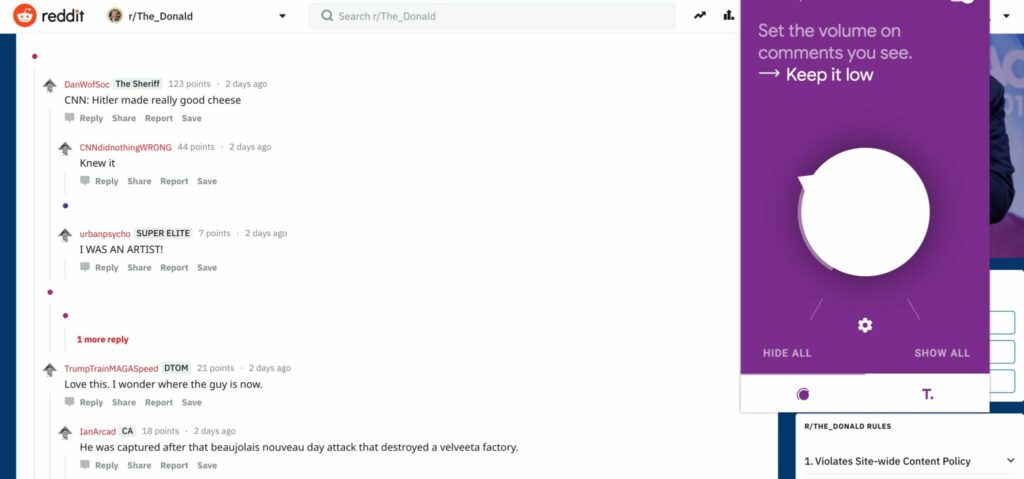

Ein Programm des Google-Partners Jigsaw soll nun Abhilfe schaffen: Mit der Browser-Erweiterung Tune lassen sich Kommentare aus grossen Plattformen wie Facebook, Twitter oder Youtube einfach ausblenden. Der Algorithmus, der bisher nur auf Englisch funktioniert, ist laut Hersteller noch in seiner experimentellen Phase.

Doch soll man sich das Internet wirklich schönfiltern? Lilian Suter, wissenschaftliche Mitarbeiterin der Fachgruppe Medienpsychologie an der ZHAW, ist skeptisch. «Wer alles Negative herausfiltert, läuft Gefahr, im eigenen Weltbild gefangen zu sein», sagt Suter. «Die Meinungsbildung braucht Pro- und Kontra-Argumente.»

Mit der Google-Software kann man mit einem Regler den Ton der Diskussion anpassen – von giftig zu gar nicht giftig. Bild: Screenshot «Tune»

Medienkompetenz statt Verdrängung

Ein freundlicheres Internet sei zwar wünschenswert, aber man bekämpfe mit solchen Massnahmen nur Symptome. «Besser als Ausblenden ist es, sich Medienkompetenz anzueignen», sagt Suter. Dazu gehöre etwa, giftige Aussagen relativieren zu können. «Man sollte sich bewusst werden, dass solche Kommentatoren oft nicht die Mehrheit repräsentieren, auch wenn es den Eindruck erweckt.»

Diesen Weg schlägt die «alliance F» ein, der Dachverband der Schweizer Frauenorganisationen. Im Rahmen des Projekts «Stop Hate Speech» entwickelt die Organisation einen Algorithmus, der Hasskommentare auf sozialen Medien und in Kommentarspalten von Schweizer Online-Medien aufspüren soll. Eine Community soll so darauf aufmerksam gemacht werden, um sich einschalten und dem Hass entgegenwirken zu können.

Auf Automatismen, die Kommentare sperren oder direkt an die Staatsanwaltschaft weiterleiten, will die «alliance F» verzichten. «Hate Speech ist kein technisches, sondern ein menschliches Problem», sagt Geschäftsführerin Sophie Achermann zu higgs. «Und dort wollen wir ansetzen, wir wollen die Medienkompetenz fördern».

Schweizer Medien offen für Automatismen

Im Spätsommer soll die Plattform mit einem lernenden Algorithmus online gehen. Eine möglichst vielfältige Gruppe von Freiwilligen wird dann Kommentare bewerten und der Software beibringen, worauf sie achten soll.

Die Software Perspective, auf der die Google-Browser-Erweiterung basiert, ist bei grossen Medien wie der New York Times und dem Guardian im Einsatz. Dort unterstützt es die Community-Teams dabei, Kommentare zur Sperrung zu selektionieren.

Auch in der Schweiz gibt es bereits technologische Lösungen. «Bei erfahrungsgemäss weniger heiklen Themen setzt 20 Minuten einen semantischen Computer ein, der die Kommentare nach gewissen Begriffen scannt», sagt Tamedia-Sprecherin Nicole Bänniger. «Bei einem Treffer wird der entsprechende Kommentar automatisch gelöscht.» Bei potentiell heiklen Themen wird noch von Hand freigeschaltet. Beim Online-Medium werden laut Bänninger täglich bis zu 15’000 Leserkommentare geschrieben, von denen zwei Drittel publiziert werden.

Auch auf blick.ch werden jeden Tag etwa 2000 Kommentare geschrieben, weswegen von 7 bis 23 Uhr ein Team im Einsatz ist, das die Beiträge von Hand freischaltet. «Eine Lösung mit Algorithmen, die unser Team bei der Moderation unterstützen, ist eine Möglichkeit, die wir verfolgen», sagt Ringier-Sprecher Manuel Bucher. «Allerdings wird es immer Kommentare geben, bei denen ein Mensch entscheiden muss, ob sie freigeschaltet werden oder nicht.»

Du willst mehr wissen?

- Die Chrome-Erweiterung «Tune»

- Das Projekt «Stop Hate Speech»

- Die Software «Perspective»