Das musst du wissen

- Die EU-Kommission hat Ethik-Leitlinien für die Entwicklung vertrauenswürdiger künstlicher Intelligenz (KI) vorgestellt

- Die Leitlinien nennen konkret sieben Bedingungen, die eine solche KI erfüllen muss.

- Unter anderem muss der Mensch immer wissen, wenn er es mit einer KI und nicht mit einem Menschen zu tun hat.

Künstliche Intelligenz (KI) kann Autos steuern, medizinische Diagnosen stellen oder Texte schreiben. Aber ob sie alles, was sie kann, auch darf und soll, ist eine andere Frage.

Heute veröffentlichte die EU-Kommission nun Ethik-Leitlinien für die künstliche Intelligenz. Diese hatte ein Gremium von 52 Experten aus Industrie, Akademie und Verbraucherschutz seit Juni 2018 erarbeitet. Die Leitlinien nennen sieben Bedingungen, die erfüllt sein müssen, damit KI aus Europa als vertrauenswürdig gilt.

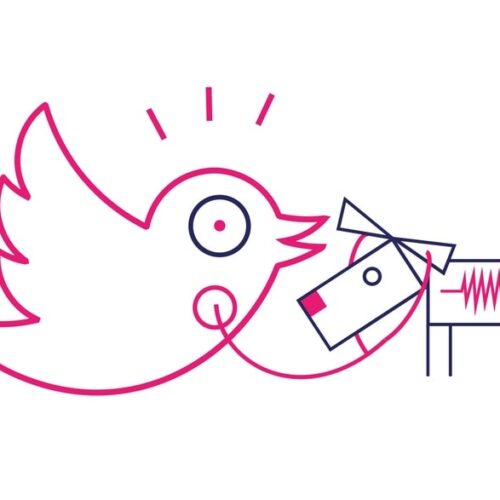

Die wichtigste Bedingung sei, dass der Mensch die Kontrolle behalte, sagte EU-Kommissarin Mariya Gabriel bei der Vorstellung der Leitlinien in Brüssel. «Menschen müssen darüber informiert sein, wenn sie mit einer künstlichen Intelligenz statt mit einem anderen Menschen interagieren». Dies trifft zum Beispiel auf Chatbots zu.

Die Leitlinien sollen Industrie, Forschung und Behörden nun in der Realität anwenden und testen. Anfang nächsten Jahres sollen dann die Ergebnisse dieser Testphase vorliegen. Die Leitlinien können dann noch einmal verändert werden.

Die sieben Bedingungen für vertrauenswürdige KI:

- Vorrang menschlichen Handelns und menschlicher Aufsicht: Systeme künstlicher Intelligenz sollten gerechten Gesellschaften dienen, indem sie das menschliche Handeln und die Wahrung der Grundrechte unterstützen‚ keinesfalls aber sollten sie die Autonomie der Menschen verringern, beschränken oder fehlleiten.

- Robustheit und Sicherheit: Eine vertrauenswürdige künstliche Intelligenz setzt Algorithmen voraus, die sicher, verlässlich und robust genug sind, um Fehler oder Unstimmigkeiten in allen Phasen des Lebenszyklus des Systems künstlicher Intelligenz zu bewältigen.

- Privatsphäre und Datenqualitätsmanagement: Die Bürgerinnen und Bürger sollten die volle Kontrolle über ihre eigenen Daten behalten, und die sie betreffenden Daten sollten nicht dazu verwendet werden, sie zu schädigen oder zu diskriminieren.

- Transparenz: Die Rückverfolgbarkeit von Systemen künstlicher Intelligenz muss sichergestellt werden.

- Vielfalt, Nichtdiskriminierung und Fairness: Systeme künstlicher Intelligenz sollten dem gesamten Spektrum menschlicher Fähigkeiten, Fertigkeiten und Anforderungen Rechnung tragen und die Barrierefreiheit gewährleisten.

- Gesellschaftliches und ökologisches Wohlergehen: Systeme künstlicher Intelligenz sollten eingesetzt werden, um einen positiven sozialen Wandel sowie die Nachhaltigkeit und ökologische Verantwortlichkeit zu fördern.

- Rechenschaftspflicht: Es sollten Mechanismen geschaffen werden, die die Verantwortlichkeit und Rechenschaftspflicht für Systeme künstlicher Intelligenz und deren Ergebnisse gewährleisten.